📌 この記事でわかること

📋 目次

2026年4月に発表された最新論文(arXiv:2604.08610v1)が、美術史とAIの世界に衝撃を与えています。中世ヨーロッパの写本に描かれた2次元の細密画(ミニアチュール)を、AIが半自動で3Dモデルに復元するフレームワークが開発されたのです。これは、専門家が手作業で行ってきた文化財の3D復元を劇的に効率化し、文化遺産を誰もが体験できるデジタル資産に変えるゲームチェンジャーです。欧米の博物館が水面下で導入を検討する一方、日本ではまだその真の価値に気づいている専門家はほとんどいません。

AIが解き明かす「描かれた世界」の奥行き

歴史的な絵画や写本は、まさに「描かれたタイムカプセル」です。しかし、それらは常に2次元の壁に阻まれてきました。もし、その絵の中に描かれた人物や建物、風景が立体的に立ち上がり、私たちがその世界を歩き回れるとしたらどうでしょうか。

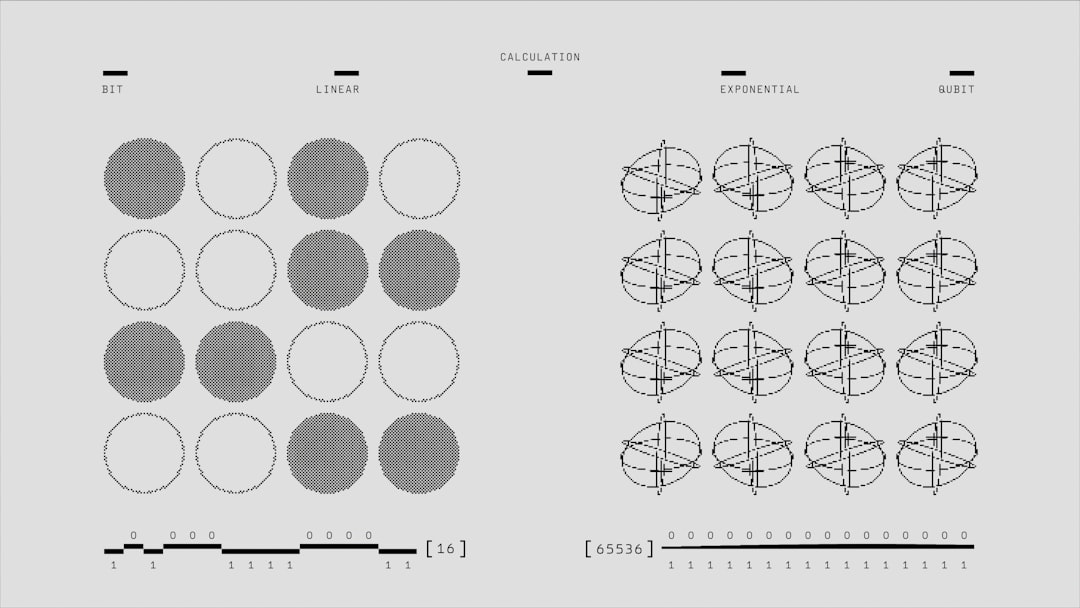

今回発表されたフレームワークは、その夢を現実にするものです。研究チームは、まず中世の写本から69体の人物像を抽出し、それらを3D化するために7種類の最新AIモデルを競わせました。具体的には、Stability AIが開発した「TripoSR」や「Wonder3D」「SAM 3D」といった、1枚の画像から3Dモデルを生成する最先端のAIたちです。

このアプローチの画期的な点は、単一のAIに頼るのではなく、複数のAIの性能を客観的な指標(シルエットの一致度や知覚的類似性など)で厳密に評価し、最適な手法を選び出したことにあります。その結果、これまで職人技に頼っていた3D復元のプロセスに、科学的な再現性と効率性をもたらしたのです。まるで、熟練の鑑定家チームがAIによって編成されたようなものです。

なぜ今、”絵画の3D化”が重要なのか?

この技術が今、注目される背景には、デジタルコンテンツ市場の構造変化があります。AppleのVision Proに代表されるXR(クロスリアリティ)デバイスの登場により、3Dコンテンツの需要は爆発的に増加しています。しかし、高品質な3Dモデルの制作には依然として高いコストと時間がかかります。

デジタル文化遺産市場

32.5%

年平均成長率(2023-2030年予測, Grand View Research)

この技術は、人類が遺した膨大な2Dの文化遺産を、この新しい3D経済圏における「デジタル資産」へと変換する可能性を秘めています。もはや文化財は、ガラスケースの向こうで静かに劣化を待つだけの存在ではありません。VR空間で再現された中世の街を歩き、ARで目の前に現れた歴史上の人物と対話する。そんな新しいエンターテイメントや教育体験を生み出すための「原材料」となるのです。

これは、不動産がメタバース上で売買されるように、歴史的資産がデジタル空間で新たな価値を持つ時代の幕開けを意味します。Google Arts & Cultureのようなプラットフォームが提供する体験を、さらにインタラクティブで没入感のあるものへと進化させる鍵となるでしょう。

7つのAIモデルが競演、最高性能はどれだ

研究チームは、まるでAIのオリンピックのように7つのモデルを競わせました。その結果は、AIの進化の速さと多様性を物語っています。評価されたのはTripoSR, SF3D, SPAR3D, TRELLIS, Wonder3D, SAM 3D, Hi3DGenという、いずれも2023年から2024年にかけて登場した最新鋭のモデルです。

総合的に最も高い評価を得たのは「TripoSR」でした。このモデルは、生成される3Dモデルの形状の正確さと、元の絵画の質感を維持する能力のバランスに優れていました。しかし、他のモデルもそれぞれに強みを持っており、例えば「Wonder3D」は細部のディテール再現に長けているなど、対象とする絵画のスタイルによって最適なAIは異なることも示唆されています。

評価されたAIモデル数

7種類

TripoSR, Wonder3Dなど2024年最新手法を網羅

この研究の真の価値は、単に「どのAIが優れているか」を示したこと以上に、「目的に応じてAIを使い分ける」という、より高度な活用法への道筋をつけた点にあります。これは、文化財のデジタルアーカイブが、単一の万能ツールではなく、多様なツールを組み合わせる洗練されたエンジニアリングの領域に進化したことを示しています。

日本への影響と今すぐできること

この技術革新は、海外だけの話ではありません。むしろ、世界有数の文化財を保有する日本にとって、計り知れないビジネスチャンスを意味します。海外では大英博物館やルーブル美術館がデジタルアーカイブ化を積極的に進めていますが、日本ではまだ一部の先進的な取り組みに留まっているのが現状です。

想像してみてください。『鳥獣人物戯画』に描かれたウサギやカエルたちが3Dキャラクターとして画面を飛び出し、コミカルに動き出す様子を。『源氏物語絵巻』の雅な世界がVR空間に広がり、光源氏が過ごした平安京の邸宅を自由に散策できる未来を。葛飾北斎の富嶽三十六景に描かれた波が、立体的なオブジェとして目の前に現れる体験を。この技術は、日本の豊かな文化資源を、世界中の人々を魅了するデジタルコンテンツへと昇華させる起爆剤となり得ます。

特に、任天堂やソニー・インタラクティブエンタテインメントといったゲーム・エンタメ企業、そして凸版印刷やNTTデータのように文化財のデジタル化に実績のある企業にとって、これは次世代のキラーコンテンツを生み出すための新たな武器庫となるでしょう。

今すぐできることは、この革命の最前線に触れることです。論文で最高評価を得た「TripoSR」はオープンソースとして公開されており、GitHubから誰でもアクセスできます。まずは手元にあるイラストや写真で、その驚くべき2D-3D変換能力を試してみてください。AIが「奥行き」をどう認識し、立体を再構築するのかを体感することは、未来のビジネスを構想する上で何よりのヒントになるはずです。

🔍 編集部の独自考察

私たちは、この技術が日本の深刻な社会課題である「文化財の維持管理における人手不足」に対する強力な処方箋になると考えています。地方の美術館や寺社に眠る膨大な文化財は、専門知識を持つ学芸員や修復家の減少により、調査や記録が追いつかず、静かに劣化が進んでいるのが現実です。このAIフレームワークを導入すれば、文化財の現状を迅速かつ低コストで3Dデータとして記録し、デジタル空間に「永遠の命」を与えることが可能になります。

📝 この記事のまとめ

さらに、これは日本が直面するDX(デジタルトランスフォーメーション)の遅れを文化・観光分野で一気に巻き返すチャンスでもあります。3D化された文化財は、単なるデジタルアーカイブに留まりません。例えば、インバウンド観光客向けに、スマートフォンをかざすだけで、城の在りし日の姿がARで現れるアプリを開発したり、メタバース上で日本の歴史を学ぶ体験型教育プログラムを世界に販売したりと、新たな収益源を生み出す「稼ぐ文化財」への転換を促します。2〜3年後には、この技術を早期に導入した自治体や企業と、そうでないところとの間で、文化観光におけるデジタル競争力に決定的な差が生まれているでしょう。

✏️ 編集部より

私たちは、このAIと人文科学の融合に、単なる技術的進歩以上の大きな可能性を感じています。歴史や芸術という、これまで人間の感性が支配してきた領域にAIが介入することで、私たちは過去をより深く、多角的に理解できるようになるでしょう。日本では、京都国立博物館などが文化財のデジタル化を進めていますが、その多くはまだ高精細な2D画像の公開に留まっています。この「3D化」という新たな次元は、日本のクリエイターやエンジニアにとって、世界がまだ知らない巨大なブルーオーシャンです。ぜひ、オープンソースのモデルに触れ、描かれた歴史に命を吹き込む興奮を体感してみてください。