📌 この記事でわかること

2024年7月、Python開発者に衝撃が走りました。圧倒的な処理速度で絶大な支持を得ていたリンター(コード静的解析ツール)兼フォーマッター「ruff」を開発する新興企業Astralが、突如OpenAIに買収されたのです。これは単なる企業買収ニュースではありません。私たちが日々ターミナルで打ち込む`pip install`というコマンドが、知らず知らずのうちに巨大AI企業の戦略に組み込まれていく、そんな未来の序章かもしれないのです。海外ではすでに「開発者の主権」を巡る議論が白熱していますが、日本ではまだこの危機感がほとんど共有されていません。

なぜOpenAIは開発ツール企業を買収したのか?

これまで、開発の根幹を支えるツール、例えばコンパイラやリンター、エディタといったものは、GoogleやMicrosoft、あるいはLinux Foundationのような組織がオープンソース(OSS)として提供し、エコシステム全体を育むのが常識でした。彼らは直接的な収益よりも、自社プラットフォームへの開発者の誘引を目的としていたのです。

しかし、OpenAIの動きは異なります。彼らは、すでにコミュニティで絶大な支持を得ていた新興のOSS企業を「買収」しました。この背景には、単なる人材獲得や技術確保以上の、極めて戦略的な狙いがあると私たちは見ています。それは、開発エコシステムの支配と、そこから得られる膨大な学習データの獲得です。

考えてみてください。ruffは世界中のPythonプロジェクトに導入されています。それはつまり、OpenAIがその気になれば、どのライブラリが一緒に使われているのか(依存関係)、どのようなコーディングスタイルが主流なのか、開発者がどんなエラーを頻繁に犯すのかといった、生々しい開発現場のデータを大規模に収集できる可能性を手に入れたことを意味します。これらのデータは、次世代のコード生成AIを訓練するための、何物にも代えがたい「燃料」となるのです。

「生産性向上」という甘い罠

もちろん、OpenAIは「開発者の生産性向上に貢献するため」という大義名分を掲げるでしょう。実際に、AstralチームがOpenAIのリソースを得ることで、ruffやuv(高速なPythonパッケージインストーラー)の開発が加速する可能性は十分にあります。しかし、その裏側で、私たちは気づかぬうちにAI企業への依存を深めていく危険性があるのです。

例えば、将来的にruffがChatGPTと深く連携し、「このコードの脆弱性は、ChatGPT Plusに登録すれば自動で修正できます」といった機能が搭載されるかもしれません。一見すると便利ですが、これは開発ツールが特定企業のAIサービスをサブスクライブさせるための入り口になることを示唆しています。

ruffの実行速度

Linter & Formatter

従来の10〜100倍

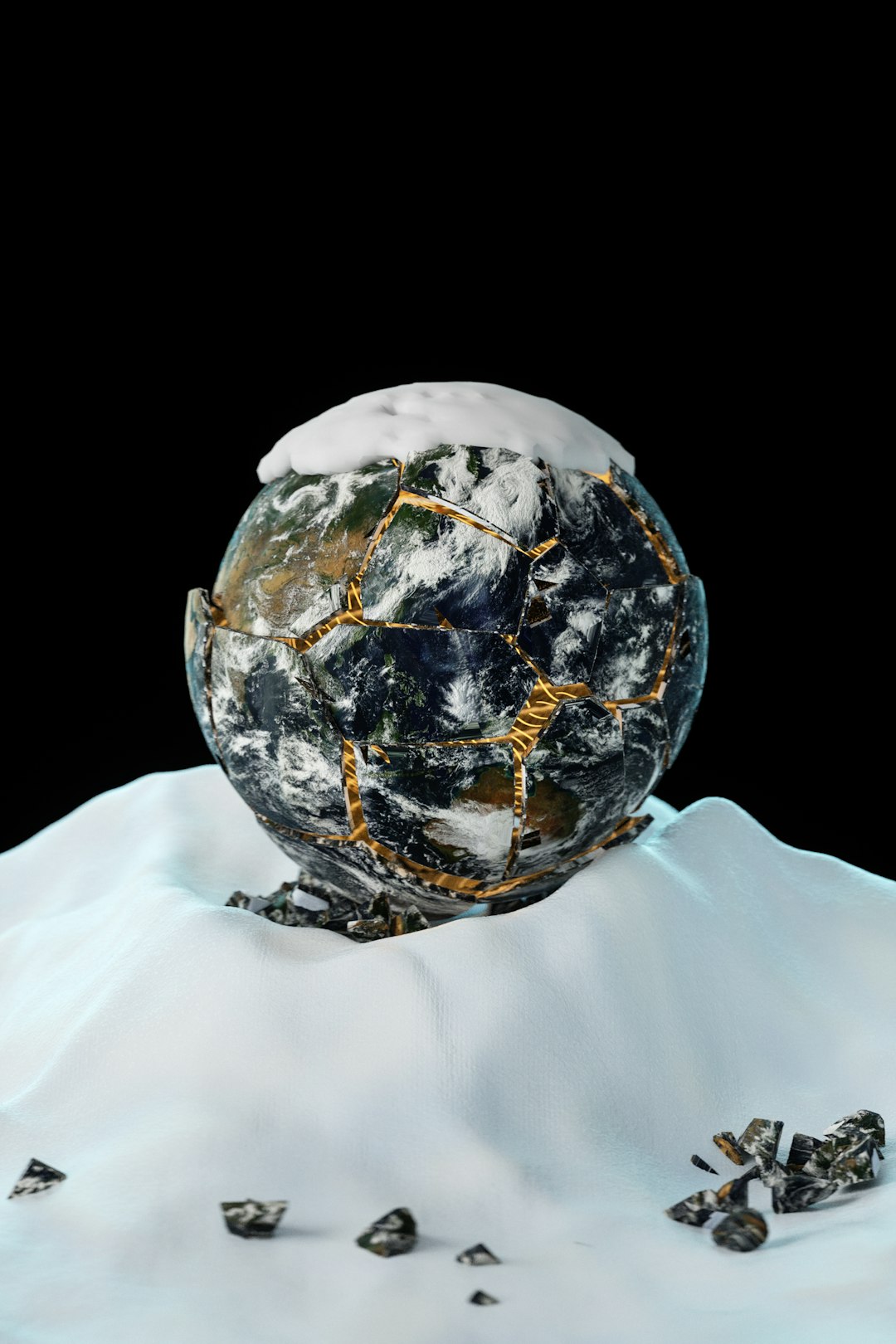

まるで、スマートフォンのOSがAppleとGoogleに支配されているように、開発環境そのものが少数のAI企業に牛耳られる未来。そこでは、技術選定の自由は失われ、私たちのコーディングという創造的な行為すら、巨大企業のデータ収集活動の一部と化してしまうかもしれません。

あなたのコードは”監視”されているか?

今回の買収で最も懸念されるのは、テレメトリー(利用状況の自動送信機能)を通じて、私たちのコードや開発環境の情報がOpenAIに送られる可能性です。現時点ではそのような実装は確認されていませんが、利用規約の変更一つで、それは現実のものとなり得ます。

もし、あなたが企業の機密情報や、特許に関わるような革新的なアルゴリズムを書いていたとしたらどうでしょう。たとえ匿名化されていたとしても、そのコードスニペットや依存ライブラリの情報が、OpenAIのモデル学習に使われる可能性はゼロではありません。

これは、GitHub Copilotが私たちのコードを学習データとして利用していることと本質的に同じ構造です。しかし、Copilotはオプトイン(利用者が能動的に選択する)ですが、開発の根幹を支えるリンターのようなツールに組み込まれた場合、それは半ば強制的、あるいは気づかないうちにデータを提供させられる「オプトアウト」の仕組みになりかねないのです。

日本への影響と今すぐできること

特に、日本の開発現場はこの変化に注意が必要です。一度導入したツールを安定性を理由に長く使い続ける傾向が強い日本では、知らず知らずのうちにOpenAIのエコシステムに深く依存してしまうリスクが高いと言えます。海外のテックコミュニティでは、すでにruffの代替ツール(例: `flake8`と`black`の再評価)や、Astralの動向を注視する動きが始まっていますが、日本ではまだこの買収を「対岸の火事」と捉える向きが強いのが現状です。

では、私たちは今すぐ何をすべきでしょうか?

1. 技術選定の再定義: これからのツール選定では、「パフォーマンス」や「機能」だけでなく、「開発元の資本関係」や「データプライバシーポリシー」を必須の評価項目に加えましょう。特に、企業の機密情報を扱うプロジェクトでは、テレメトリー機能の有無を徹底的に調査すべきです。

2. 代替ツールの存在を常に意識する: ruffは確かに高速で優れていますが、唯一の選択肢ではありません。`flake8`, `pylint`, `black`, `isort`といった伝統的なツール群を組み合わせる選択肢も依然として有効です。特定のツールに依存しすぎず、いつでも乗り換えられる準備をしておくことが、開発者の主権を守るための防衛策となります。

3. 社内での議論を始める: 「このツールを使い続けることで、我々のコードや開発ノウハウはどこへ行くのか?」という問いを、ぜひチーム内で議論してみてください。一人の開発者が声を上げることで、組織全体の意識が変わり、より安全な技術選定の文化が醸成されるはずです。

今回の買収は、AIがソフトウェア開発のあり方を根底から変えようとしている現実を、私たちに突きつけています。

🔍 編集部の独自考察

📝 この記事のまとめ

今回のOpenAIによるAstral買収は、日本の製造業や大手SIerにとって特に大きな警鐘となるべきです。これらの企業では、人手不足やDX化の遅れを背景に、開発効率を劇的に向上させるツールへの期待が非常に高まっています。しかし、その「効率化」の裏で、長年培ってきた独自の製造ノウハウや業務ロジックが詰まったソースコードの情報が、意図せず外部のAIモデルに学習データとして提供されるリスクを孕んでいます。例えば、トヨタの自動運転アルゴリズムや、ソニーの画像処理エンジンに関するコード断片が、開発ツール経由で吸収される可能性は否定できません。早期にこのリスクを認識し、データガバナンスを強化した企業と、利便性だけを追求して無自覚に使い続けた企業とでは、2〜3年後には競争力の源泉である知的財産の価値に大きな差が生まれるでしょう。今こそ、目先の効率だけでなく、「技術的負債」ならぬ「データ主権的負債」という新たな視点を持つべき時です。

✏️ 編集部より

私たちは、今回の買収を単なる技術ニュースではなく、開発者一人ひとりの未来の選択に関わる、重大な転換点だと捉えています。Pythonというオープンなエコシステムの中で生まれた革新的なツールが、巨大AI企業の閉じた戦略の一部に組み込まれていく。この流れは、私たちエンジニアが「何を作るか」だけでなく、「どの道具で、誰のために作るか」をより深く問われる時代の到来を告げています。利便性の裏にある代償を意識し、自らのデータを守るリテラシーを持つこと。それこそが、これからのエンジニアにとって不可欠なスキルになるのかもしれません。ぜひ、この衝撃的なニュースをきっかけに、チーム内で一度立ち止まって議論してみてください。