📌 この記事でわかること

📋 目次

最近起きたAnthropicのコード流出事件は、AI業界に衝撃を与えました。それは、彼らのClaudeモデルの強みがモデル自体ではなく、それを精密に制御する周辺技術「ハーネス」にあることを図らずも証明したからです。この「ハーネスエンジニアリング」という概念は、日本ではまだほとんど議論されておらず、多くの企業が見落としているAI活用の死角となっています。

LLMの性能競争は、すでに終わっている

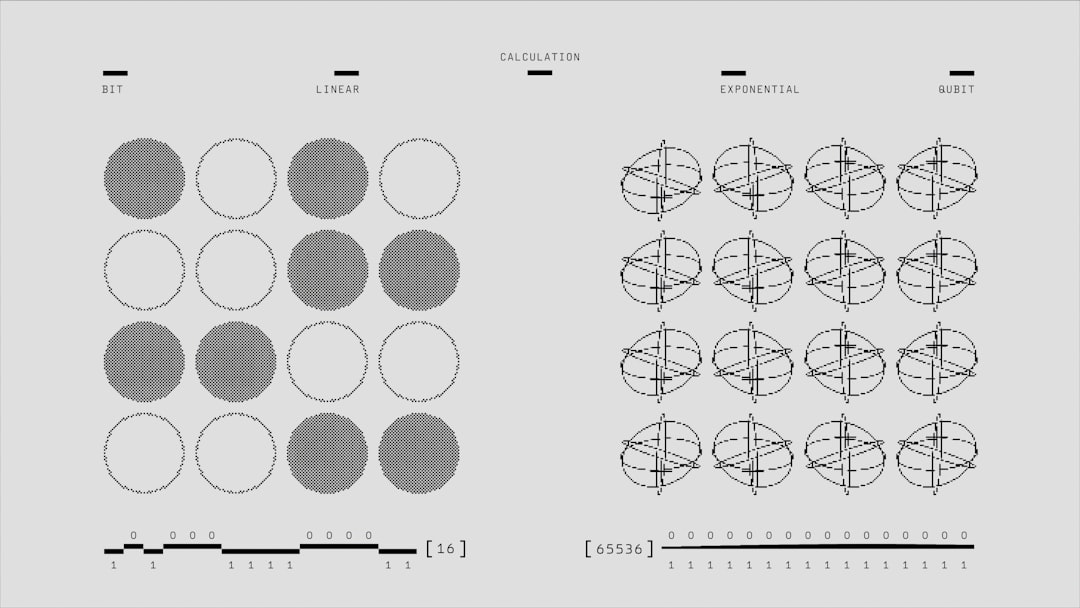

AI業界の話題は、常に新しい大規模言語モデル(LLM)の性能スコアで持ちきりです。GPT-4o、Claude 3.5 Sonnet、Gemini 1.5 Pro――。各社が競い合うようにベンチマークスコアを更新しますが、その差はますます僅差になっています。もはや、一般ユーザーや多くの企業ユースケースにおいて、トップモデル間の性能差は体感できないレベルにまで収束しつつあります。

これは、LLMというエンジンそのものがコモディティ化(汎用品化)し始めたことを意味します。かつて自動車産業で、どのメーカーのエンジンも一定水準以上の性能を持つようになったのと同じです。そうなると、競争の主戦場はエンジン性能そのものではなく、乗り心地、安全性、燃費といった「エンジンをどう使いこなすか」という周辺技術に移っていきます。

AIの世界で今まさに起きているのが、このパラダイムシフトです。モデルの性能スコアだけを追いかけて最適なLLMを選定しようとするアプローチは、F1マシンのエンジンだけを購入して、自社の軽トラックに載せようとするようなものかもしれません。本当に重要なのは、その強力なエンジンを自社の目的に合わせて完璧に制御する仕組みなのです。

Anthropicが隠していた「ハーネス」という名の心臓部

今回のAnthropicのコード流出で明らかになったのは、彼らがLLMというエンジンを動かすために、いかに洗練された制御システム、すなわち「ハーネス」を構築しているかという事実でした。ハーネスとは、馬を操るための手綱や馬具を意味する言葉ですが、AI開発においてはLLMを安定して高精度に動かすための周辺エンジニアリング全体を指します。

漏洩したコードには、単純なAPI呼び出しだけではない、驚くほど緻密な仕組みが含まれていました。例えば、以下のような機能です。

* プロンプトの自動最適化: ユーザーの入力(プロンプト)をそのままLLMに渡すのではなく、内部で複数のパターンに自動変換し、最も質の高い回答を生成できるプロンプトを選択して実行する。

* 自己修復エラーハンドリング: LLMが不適切な回答やエラーを返した場合、それを自動で検知し、異なるアプローチで再度プロンプトを生成し直す。

* 出力フォーマットの強制: 回答を必ずJSON形式や特定の構造で出力させるための、何重ものガードレール(制約)を設けている。

* コンテキスト管理: 長い対話の文脈をLLMが失わないように、要約や重要情報の抽出を自動で行い、常に最適な情報をLLMに与え続ける。

これらは、LLMという気まぐれでパワフルな猛獣を、ビジネスの現場で使える従順な家畜へと変えるための「手綱」です。エンジン(LLM)がいかに強力でも、この精密なハーネスがなければ、暴走したり、期待通りの性能を発揮できなかったりするのです。

AIプロジェクト失敗率

85%

2025年予測(Gartner)

なぜあなたの会社のAIは「期待外れ」に終わるのか

「最新のGPT-4oを導入したのに、なぜか現場では使えない」「PoC(概念実証)では上手くいったのに、本番運用すると回答が安定しない」。こうした声は、日本の多くの企業で聞かれます。その根本原因のほとんどは、このハーネスエンジニアリングの欠如にあります。

多くの企業は、LLMをAPI経由で呼び出すだけで満足してしまいます。しかし、これはF1エンジンを剥き出しのまま動かしているような状態です。幻覚(ハルシネーション)を抑制する仕組みも、業務特有の専門用語を理解させる仕組みも、個人情報のような機微な情報をフィルタリングする仕組みもありません。

結果として、AIの回答は不安定になり、「時々すごいが、基本的には使えない」という烙印を押されてしまいます。これはLLMモデル自体の性能の問題ではなく、その性能を100%引き出し、業務プロセスに組み込むためのハーネスが存在しないという、アーキテクチャの問題なのです。GoogleやMicrosoftが自社サービスに生成AIを深く統合できているのは、彼らが長年培ってきた、こうした周辺エンジニアリングのノウハウがあるからに他なりません。

日本への影響と今すぐできること

このハーネスエンジニアリングという概念は、日本のAI活用に大きな警鐘を鳴らしています。特に、システム開発を外部のSIerに丸投げすることが多い日本のビジネス文化は、自社内にハーネスのノウハウが蓄積されにくい構造的な問題を抱えています。

海外の先進企業、例えばNetflixがユーザーごとに最適化された推薦文を生成したり、Uberが需要予測の精度を高めたりしている背景には、彼らが独自に構築した巨大なAIプラットフォーム、つまり洗練されたハーネスの存在があります。一方、日本では多くの企業が「どのモデルを使うか」という議論に終始し、その先の「どう使いこなすか」という最も重要なステップを見過ごしがちです。トヨタやソニーといった技術力のある企業でさえ、この新しい戦場で優位性を保つには、ソフトウェアエンジニアリングへのより一層の投資が不可欠となるでしょう。

では、私たちは今すぐ何をすべきでしょうか。

1. AI活用の目的を再定義する: まず、「AIで何がしたいか」を曖昧なままにせず、「顧客からの問い合わせに対し、3つの選択肢をJSON形式で95%以上の精度で返す」といったレベルまで具体化します。これにより、必要なハーネスの機能(フォーマット制御、精度監視など)が明確になります。

2. OSSフレームワークで小さく始める: LangChainやLlamaIndexといったオープンソースのフレームワークは、ハーネスを構築するための優れたツールキットです。これらを活用し、プロンプトのテンプレート化や外部データとの連携(RAG)といった基本的なハーネスを内製で構築する経験を積むことが重要です。

3. モデル評価の基準を変える: LLMを選定する際、ベンチマークスコアだけでなく、「APIのレスポンスタイムは安定しているか」「エラーメッセージは分かりやすいか」「特定の出力を強制する機能はあるか」といった、ハーネスとの親和性を評価項目に加えるべきです。

このシフトは、日本のエンジニアにとって大きなチャンスです。LLM本体を開発するのは巨大資本を持つ企業に限られますが、各企業の個別業務に最適化されたハーネス構築は、現場を知る日本のエンジニアだからこそ価値を発揮できる領域なのです。

🔍 編集部の独自考察

ハーネスエンジニアリングの重要性は、特に日本の社会課題解決において大きな意味を持つと私たちは考えています。例えば、深刻な人手不足に悩む製造業の現場。ベテラン職人の暗黙知を単にLLMに学習させるだけでは、実用的なAIは生まれません。重要なのは、現場のセンサーデータや過去のトラブル報告書をリアルタイムで処理し、最適な形でLLMに情報を与え、危険を予知する警告を特定のフォーマットで出力させる、といった一連のプロセスを自動化するハーネスです。

📝 この記事のまとめ

また、DX化が遅れている中小企業にとっても、これは好機となり得ます。自社で巨大なLLMを開発する必要はなく、オープンなモデルを使い、自社の業務プロセスに特化した「秘伝のタレ」としてのハーネスを構築することにリソースを集中すれば、大企業とも渡り合える独自の競争力を生み出せる可能性があります。今後2〜3年で、このハーネス構築に長けた企業と、単にLLMをAPIで呼び出すだけの企業との間には、生産性において埋めがたい差が生まれることは間違いないでしょう。

✏️ 編集部より

私たちも当初は、次々と発表される新しいLLMの性能にばかり目を奪われがちでした。しかし、今回のAnthropicの事例が示す「ハーネス」という視点は、まさに目から鱗でした。AIの真価は、モデルの頭の良さだけでなく、それをいかに社会やビジネスの現場で「賢く、安全に、安定して」動かすかにかかっています。これは、日本の多くの企業にとって脅威であると同時に、巨大テック企業に依存せずとも独自の強みを築ける大きなチャンスです。まずは自社の業務プロセスをAIにどう「翻訳」するか、その「高性能な翻訳機」としてのハーネスを考えることから始めてみてはいかがでしょうか。

コメントを残す